Le modèle o3 d'OpenAI : Pionnier d'une nouvelle ère dans l'extensibilité de l'IA avec le calcul en phase de test

À la fin de l'année 2023, OpenAI a lancé son modèle o3, marquant le début d'une nouvelle phase dans l'extensibilité de l'IA, propulsée par le concept de scalabilité en phase de test. Cette approche, qui utilise des ressources informatiques supplémentaires pendant la phase d'inférence, a déjà montré des résultats impressionnants, mais elle comporte également des compromis importants.

Le rôle de la scalabilité en phase de test dans les progrès de l'IA

La scalabilité en phase de test représente un changement dans la manière dont les modèles d'IA sont entraînés et déployés. Au lieu de s'appuyer uniquement sur un pré-entraînement pendant le développement du modèle, le modèle o3 d'OpenAI améliore les performances en déployant de la puissance de calcul supplémentaire lors de la génération des réponses aux requêtes des utilisateurs. Cette méthode a donné lieu à des améliorations significatives, comme en témoigne la performance du modèle o3 sur le banc d'essai ARC-AGI, où il a obtenu un score de 88 %, une augmentation frappante par rapport à son prédécesseur, le modèle o1, qui n'avait obtenu que 32 %.

Cependant, cet incroyable gain en performance s'accompagne d'un coût élevé. La version haute performance de o3 a consommé plus de 1 000 $ de ressources de calcul par tâche, alors que le modèle précédent, o1, n'avait besoin que d'environ 5 $. Cette différence de coût rend o3 peu pratique pour une utilisation quotidienne, le positionnant comme un outil mieux adapté à des applications plus spécialisées et à enjeux élevés.

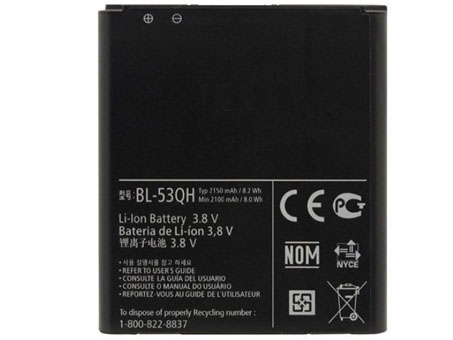

>>> NZ852558 pour RC ERA C190 H145

Ce que cela signifie pour l'avenir de l'IA

Les progrès rapides réalisés entre o1 et o3 en seulement quelques mois ont alimenté l'optimisme quant à l'avenir de l'IA. Jack Clark, co-fondateur d'Anthropic, a soutenu que les avancées de 2025 combineraient la scalabilité en phase de test avec les techniques de pré-entraînement traditionnelles pour stimuler de nouvelles percées dans le domaine de l'IA. Cependant, l'imprévisibilité des coûts de calcul introduit un élément d'incertitude, compliquant la faisabilité financière de l'exécution de ces modèles à grande échelle.

Bien que o3 illustre la puissance de la scalabilité en phase de test, il n'est pas sans limites. François Chollet, créateur du test ARC-AGI, a souligné que bien que o3 montre une grande capacité d'adaptation aux tâches nouvelles, il peine encore sur des problèmes plus simples que les humains peuvent résoudre facilement. De plus, il est important de noter que l'AGI (Intelligence Artificielle Générale) reste hors de portée — o3 représente une avancée, mais il est loin d'atteindre une intelligence comparable à celle des humains.

De plus, o3 continue de lutter contre des problèmes courants dans les grands modèles linguistiques, tels que les hallucinations, où le modèle génère des réponses incorrectes ou trompeuses. Cela met en évidence le défi persistant de créer des systèmes d'IA véritablement fiables, ce qui pourrait constituer un obstacle majeur à une adoption plus large.

La voie à suivre : équilibrer performance et coût

Malgré ses capacités impressionnantes, les exigences computationnelles substantielles du modèle o3 signifient que seules les organisations disposant de ressources importantes pourront tirer pleinement parti de sa puissance. En réponse, l'industrie de l'IA se concentre de plus en plus sur le développement de puces d'inférence IA plus efficaces. Des startups comme Groq et Cerebras sont en première ligne de cet effort, travaillant sur du matériel spécialisé conçu pour réduire le coût de l'exécution de modèles haute performance comme o3.

Ces innovations matérielles pourraient ouvrir la voie à des systèmes d'IA plus rentables qui conservent les avantages de la scalabilité en phase de test sans les coûts prohibitifs. Pour l'instant, cependant, o3 et des modèles similaires resteront probablement des outils réservés aux institutions à gros budget, laissant les utilisateurs quotidiens se tourner vers des options d'IA plus abordables.

>>> Li3959T45P8h816761 pour Nubia Z60 Ultra NX721J

Conclusion : un bond transformateur dans l'extensibilité de l'IA

L'introduction de o3 marque un saut significatif dans l'extensibilité de l'IA, avec la scalabilité en phase de test s'avérant être un outil puissant pour améliorer les performances. Cependant, les coûts computationnels élevés associés à ces modèles représentent un défi majeur pour leur utilisation à grande échelle. À mesure que les entreprises d'IA continuent d'affiner leurs méthodes et de développer du matériel plus efficace, l'avenir de l'extensibilité de l'IA dépendra de l'équilibre entre performance, accessibilité et coût.